GPUの発展とともにシミュレーションを高速化させるプロメテック

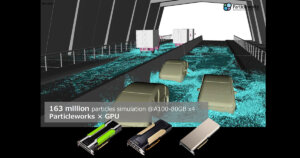

【水冷 NVIDIA A100 GPU 導入事例】1.5億粒子規模の解析をデスクトップワークステーションで実現!NVIDIA A100 GPUのベンチマークでは4基で約37倍、CPU換算で1,000~1,500コア相当のパフォーマンス。

シミュレーションをGPUコード化し計算速度を飛躍的に向上

【NVIDIA A100 GPU 導入事例】大規模な事象をシミュレーションして解析するには今までの計算リソースでは対応できない課題を、研究コードのGPU化によりCPUの約10倍に!

AIで日本語のさらなる利活用を目指す朝日新聞社

【NVIDIA A100 GPU 導入事例】膨大な日本語データを活用したAI研究が盛んに行われている朝日新聞社。NVIDIA A100 GPUで2~3倍の作業効率化。オンプレミスでGPUサーバーを持つメリットとは。

流体力学研究は次のステージへ。

社会に求められる研究にGPUソリューションが貢献

【NVIDIA RTX A6000 導入事例】流体力学を研究されている九州工業大学物理情報工学科、NVIDIA RTX A6000搭載ワークステーションを導入。CPUで60分かかっていた演算処理がGPU活用で1分に短縮。GPUによる研究効果をご紹介!

自律型自動運転の未来を切り拓くNVIDIA DGX A100

【NVIDIA DGX A100 導入事例】近未来の交通インフラの主流として期待されている自律型自動運転自動車。NVIDIA DGX A100を活用し、AIによる自動運転の研究でこの分野の最先端を進み続ける金沢大学の取り組みをご紹介!